ニュースの概要

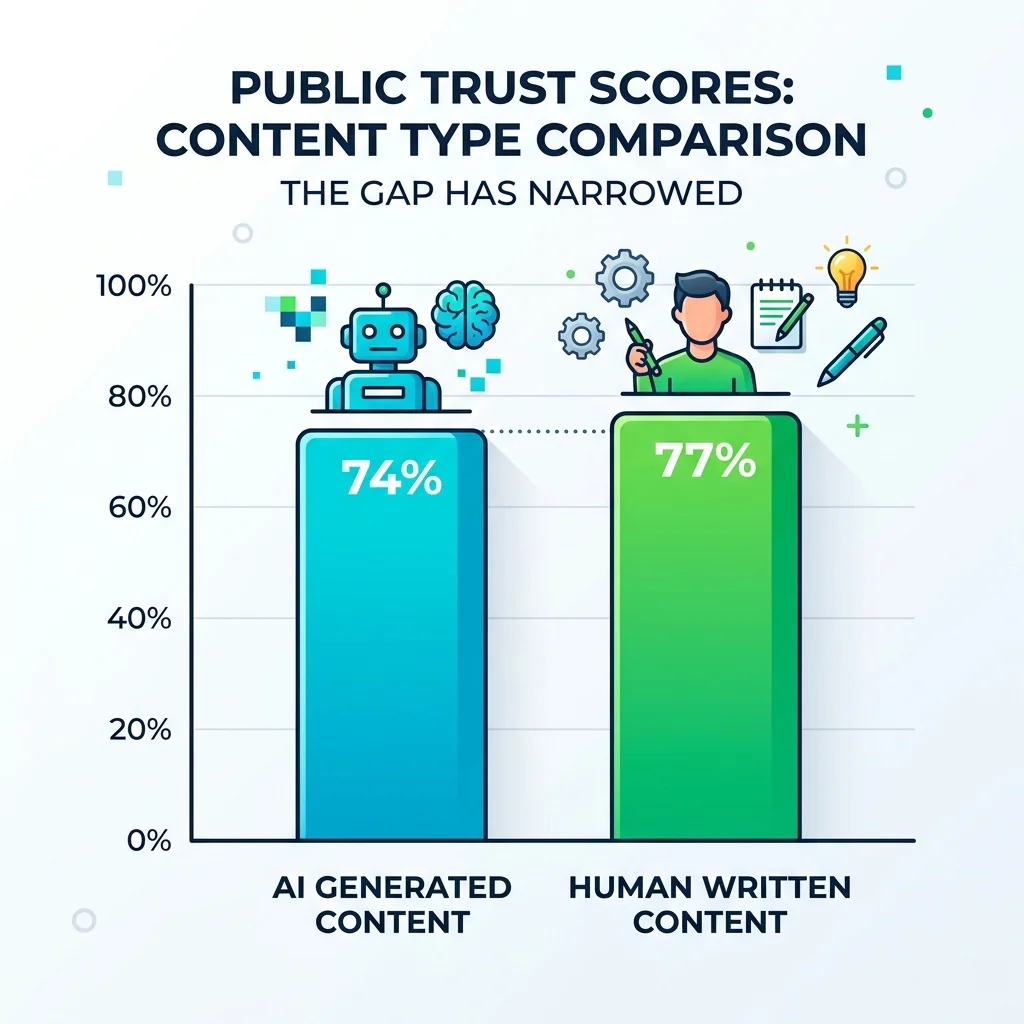

ロイター・インスティテュート「デジタルニュースレポート2024」(オックスフォード大学)によれば、日本のニュース全体への信頼度は約40%で、調査46カ国中下位に位置する。一方、総務省「令和6年版情報通信白書」(2024年)はAIによる偽情報・ディープフェイクの増加を主要リスクとして警告し、国内でも生成AIを活用したコンテンツが検索・SNSを通じて拡散する事例が報告されている。日本新聞協会は2024年に「生成AI利活用に関する基本見解」を公表し、AIを使った記事作成にあたっては事実確認の責任が従来と変わらず媒体側にあると明記した。

独自ファクトチェック・検証視点

ロイター・インスティテュート「デジタルニュースレポート2024」は実在する国際調査で、日本の信頼度スコアは公式サイトで確認できる。総務省「令和6年版情報通信白書」におけるAI偽情報への言及は同白書第2章で扱われている。日本新聞協会の基本見解(2024年)は同協会ウェブサイトで公開されている。「生成AIを使った記事が増加している」という大前提はAP通信・Bloomberg・MSNなど海外事例で確認できるが、国内主要媒体の具体的な比率・本数は非公表のものが多く、本記事では「活用が拡大している」という方向性の表現に留める。AI記事の品質と信頼の関係については現在も研究が進行中であり、断定的な結論は存在しない点に留意が必要。

スマートフォンでニュースを開いたとき、その記事が人間のジャーナリストによるものか、AIが生成したものか——あなたは見分けられるだろうか。 2024年以降、国内外のメディアでAIによるコンテンツ生成の活用が急拡大した。 「読む」行為の前提そのものが変わりつつある今、メディアリテラシーは再定義の局面にある。

「AIが書いた記事って、パッと見て分かるもんじゃないの? なんか違和感あったりしないかのう?」

「それが問題なのよ。精度が上がるにつれて、文体・構成・語調のレベルでは区別がほぼつかなくなってきた。むしろ人間より文法的に正確で読みやすい文章を生成できる場合もある。」

「問題は文章の上手さじゃない。そこに書かれた事実の出どころを、誰が検証したかだ。」

信頼が崩れているのはAIのせいか、メディアのせいか、それとも読者の変化か。

全体への信頼度

日本は信頼度下位

が主要リスクに

事実確認は媒体側

AIが生成した記事かどうかより、「誰が、何を根拠に、どう検証したか」が信頼の決め手になる時代へ。

「AIが書いた」ことは、なぜわからないのか

生成AIの文章生成能力は、2023〜2024年で急速に向上した。特に要約・整理・リライトの領域では、人間の文章と統計的に区別がつきにくいレベルに達しつつある。

AI検出ツール(AI Content Detectors)はすでに多数存在するが、信頼性は一定ではない。テキストを若干リライトすれば「人間作成」と判定させることも容易で、検出とすり抜けの軍拡競争が続いている。この状況は、読者が「AIかどうか」を個人判断する方向ではなく、媒体がプロセスを透明化する方向に解決を求める必要性を示唆している。

海外では媒体がAI活用の度合いをラベル表示する動きが始まっている。APやBloombergは限定的な範囲でAI生成コンテンツをリリースしており、一部はその旨を明記している。一方、日本国内ではそうした表示基準が業界標準として定まっていないのが現状だ。

「検出ツールが当てにならないなら、読者はどうやって信頼すればいいんじゃ?」

「個々の記事より、媒体全体のプロセス設計を評価する方が合理的よ。記事が人間製かAI製かより、その媒体が出典を明記しているか・事実確認のプロセスを持っているか・間違いを訂正するかを見るの。」

「つまり今まで通りの基準で見ればいい。違うのは、それを今まで以上に意識して使わないといけなくなったことだ。」

信頼の「根拠」が変わる——出典主義から検証プロセス主義へ

従来のメディアリテラシー教育では、「一次情報に当たれ」「政府発表・学術論文を確認せよ」という出典主義が中心だった。AIコンテンツの台頭は、この枠組みに揺さぶりをかけている。

AIは大量の一次情報を学習したうえで文章を生成できる。そのため、表面上は出典らしく見えるが実在しないURLを文中に埋め込む「ハルシネーション」が問題になっている。一次情報を示していることと、それが実際に存在し正確に引用されていることは別の話だ。

信頼の評価軸は、出典の「格」から、検証プロセスの「透明性」へとシフトしている。

具体的には以下の問いが有効になる:

- 記事内のリンクは実際にクリックして内容を確認できるか?

- 引用された数値が、原資料の文脈から切り取られていないか?

- 媒体側が、記事のどの部分をどのプロセスで確認したかを説明しているか?

これは読者にとっての「リテラシー」であると同時に、メディア側が「編集の透明性」として開示する責任の問題でもある。

「検証の可視化」がメディアの新しい差別化になる

ロイター・インスティテュートの2024年調査でニュース信頼度が低水準を示した日本において、信頼の回復は急務だ。AI生成コンテンツへの不信が背景にあるとすれば、処方箋は「AIを使わない」ではなく、「プロセスを見せる」ことになる。

NT Mediaが開発したZash Fact Engine(ZFE)は、この文脈で機能する。記事内で引用されたソースURLを自動クローリングし、本文の主張と照合してスコアを算出する仕組みだ。これは読者に「このサイトは検証しています」という信頼シグナルを提供すると同時に、編集者が「見えていなかった引用の齟齬」に気づくための内部ツールでもある。

ZFEのような仕組みが普及することで、読者は「AIかどうか」ではなく「検証されているかどうか」を基準に情報を選別できるようになる。それは生成AIの普及以前にも必要だった能力だが、今この瞬間に急速に要請されているものでもある。

「じゃあZFEがついてるってことは、ちゃんと確認してますよって証拠なんじゃな!」

「ツールは道具よ。大事なのは、そのスコアが出た理由を編集部が理解して、読者に説明できること。スコアが高いからOK、ではなく、なぜ高いのかを問い続けることが重要。」

「検証ツールを使って誠実に見えようとするのと、実際に誠実であるのは違う。読者はそのうち見抜くようになる。だからこそ、中身を伴わせる必要がある。」

- Reuters Institute Digital News Report 2024(オックスフォード大学)

- 総務省「令和6年版情報通信白書」(2024年)

- 日本新聞協会(公式サイト・AI利活用に関する声明・指針を掲載)

- 総務省「情報通信白書」(AI・ディープフェイク等のリスク分析を収録)

補足情報

- 初稿作成: 2026-04-04

- Issue: https://github.com/Terralien-jp/sites/issues/5

AIが書いた記事かどうかを見分けることに、今のところ完全な方法はない。しかし問うべき問いは「AI製か人間製か」ではなく、「その情報は誰が、何を根拠に、どう検証したか」だ。ロイター・インスティテュート2024年調査が示す日本の信頼度40%という数字は、AIの台頭前から積み上がってきた不信の蓄積でもある。AI時代のメディアリテラシーは、出典の「格」よりも検証プロセスの「透明性」を評価する方向へ進化する必要がある。媒体側は「AIを使うかどうか」ではなく「プロセスをどう見せるか」で競争することになる。それは読者にとって、より確かな信頼の土台になる。